Strategia sprzedaży Samsunga dotycząca sprzedaży telewizorów w 2020 roku jest prosta: 8,000 lub mniej. Podczas gdy sprzedaż budżetowych telewizorów 4K QLED nie jest w pełni wykorzystywana przez budżetowe telewizory 4K, Samsung planuje ponownie przenieść rynek do formatu, który ma (jak dotąd) bardzo niewielu konkurentów, ale także bardzo mało treści natywnych.

Jednak, jak widzieliśmy w naszym 4K vs. 8K na początku tego roku, tak naprawdę nie potrzebujesz materiału wideo w rozdzielczości 780×4320 (8K), aby nagrać te miliony pikseli: telewizory Samsung 8K wykorzystują konwersję w górę do konwersji dowolnego obrazu. typ wideo (od SD do 4K i wszystko pomiędzy) w rozdzielczości 8K.

Oczywiście wzrost poziomu nie jest niczym nowym. Przez lata telewizory 4K, a nawet HD znajdowały sposoby na rozciąganie treści o niskiej rozdzielczości, aby pasowały do wyższego stosunku pikseli do cala w nowoczesnych telewizorach. Ale ponieważ telewizory 8K muszą zajmować cztery piksele 4K, konwencjonalne metody konwersji w górę po prostu nie działają, z powodów, które omówimy później.

Teraz, po odwiedzeniu laboratoriów kontroli jakości Samsunga w New Jersey i rozmowie z jego inżynierami, mamy lepsze pojęcie o tym, jak Samsung wykorzystuje sztuczną inteligencję i uczenie maszynowe, aby wyglądało to tak. czy możliwe jest przeskalowanie 8K i jak jego techniki AI porównują się z wczesnymi wysiłkami producentów.

Dlaczego konwencjonalne ulepszenia wyglądały tak okropnie?

Przed 1998 rokiem transmisje telewizyjne miały rozdzielczość 720x480, a filmy nagrywane w wyższej jakości były kompresowane do tego formatu. To 345,600 2 pikseli treści, które zajmowałyby tylko małe okno na nowoczesnych telewizorach z wyższymi współczynnikami PPI (pikseli na cal). Ta zawartość SD? Musi rozszerzyć się, aby pokryć ponad 8 miliony pikseli w wysokiej rozdzielczości, ponad 4 milionów w przypadku 33K lub ponad 8 miliony w przypadku XNUMXK.

Podstawą skalowania jest zachowanie prawidłowego stosunku pikseli przy użyciu prostego mnożenia. Aby przekonwertować HD na 4K, procesor telewizora musi wykorzystać jeden piksel HD, aby zająć cztery piksele miejsca na ekranie o wyższej rozdzielczości. Lub 16 pikseli przy konwersji HD-8K.

(Zdjęcie: Sony)

Bez żadnego przetwarzania obrazu obraz skończył, cytując Tolkiena, „w jakiś sposób rozciągnięty, jak masło zeskrobane ze zbyt dużej ilości chleba”. Każdy fragment danych staje się nienormalnie kwadratowy, bez naturalnego przejścia między szczegółami i kolorami. Powoduje to dużą blokadę lub szum wokół obiektów na ekranie.

Prawdopodobnie zobaczysz też coś, co nazywa się „odgłosami komarów”. Aby skompresować wideo do pracy przy ograniczonej przepustowości łącza internetowego, nadawcy i strony internetowe muszą zakończyć przepływ celowych defektów kolorów lub „artefaktów kompresji”. Celowo uszkodzone piksele roją się wokół obszarów ekranu, w których znajdują się ostre kontrasty, jak brązowy most na tle błękitnego nieba na powyższym obrazku.

Matematyka kryjąca się za ruchem luksusowym

W obliczu tych problemów programiści telewizyjni nauczyli swoje telewizory cyfrowej analizy i przetwarzania obrazów w czasie rzeczywistym w celu wypełnienia lub naprawy brakujących lub uszkodzonych pikseli. Osiągnęli to za pomocą funkcji matematycznych, które możesz przekazać swoim bliskim, gdy następnym razem powiedzą, że zbyt wiele telewizorów psuje ci mózg.

W szczególności inżynierowie nauczyli procesor telewizora interpolować wartość koloru każdego brakującego piksela na podstawie otaczających pikseli. Aby to zrobić, musiał zdefiniować jego jądro: funkcję, która przypisuje priorytet koloru sąsiadom piksela, zgodnie z ich bliskością.

Najbardziej podstawowym jądrem używanym w telewizorach jest jądro najbliższe, które po prostu oblicza, który piksel jest najbliższy pustemu pikselowi i wkleja te same dane kolorów do pustego piksela. Ta metoda powoduje, że obraz przyjmuje blokowy wzór zygzakowaty lub aliasing z niewyraźną krawędzią. Wyobraź sobie czarną literę „A” na białym ekranie; brakujący piksel tuż poza literą może być wypełniony na czarno, podczas gdy piksel na krawędzi litery może być biały. Rezultatem będzie szara plama wokół litery lub nieregularne czarno-białe schody biegnące w górę iw dół.

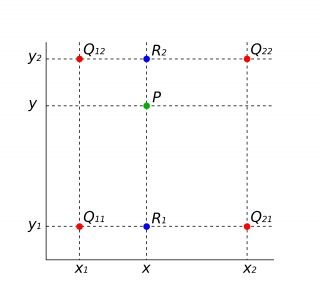

Ten wykres przedstawia proces obliczania pustego piksela (zielona kropka „P”) w oparciu o interpolację dwuliniową.

(Źródło zdjęcia: domena publiczna)

Interpolacja dwuliniowa wymaga większej mocy obliczeniowej, ale jest bardziej wydajna. W tej metodzie pusty piksel jest porównywany z dwoma najbliższymi sąsiadami, tworząc między nimi liniowy gradient, poprawiając w ten sposób ostrość obrazu. Daje to gładsze efekty wizualne, ale może być niespójne. Dlatego inne telewizory używają interpolacji dwusześciennej, która strzela do najbliższych 16 pikseli we wszystkich kierunkach. Chociaż ta metoda pozwala na uzyskanie możliwie najdokładniejszego koloru, daje również znacznie bardziej rozproszony obraz, a kontury nabierają irytującego efektu halo.

Prawdopodobnie już odgadłeś problem: te telewizory wypełniają piksele na podstawie wzorów matematycznych, które statystycznie częściej dają dokładne obrazy, ale nie mają możliwości zinterpretowania ich wyglądu tematycznego zgodnie z tym, co jest faktycznie wyświetlane na ekranie.

Dlatego po wyjaśnieniu, w jaki sposób te algorytmy były konsekwentnie nieskuteczne, zespół Samsunga wyjaśnił, w jaki sposób jego sztuczna inteligencja przezwycięża te wady.

Sekret Samsunga: uczenie maszynowe, rozpoznawanie obiektów i filtry

(Zdjęcie: Samsung)

Tajną bronią Samsunga jest technika zwana super rozdzielczością uczenia maszynowego (MLSR). Ten system oparty na sztucznej inteligencji pobiera strumień wideo o niższej rozdzielczości i zmienia jego rozmiar, aby dopasować go do rozdzielczości większego ekranu z wyższym współczynnikiem PPI. To stary odpowiednik informatyka, który podchodzi i „poprawia” rozmyty obraz po prostu naciskając klawisz, z wyjątkiem tego, że odbywa się to automatycznie i niemal natychmiast.

Przedstawiciele Samsunga wyjaśnili, w jaki sposób przeanalizowali dużą ilość treści wideo z różnych źródeł (wysokiej i niskiej jakości źródła YouTube, DVD i Blu-Ray, filmy i wydarzenia sportowe) i utworzyli dwie bazy danych. obrazy, jeden dla słabych zrzutów ekranu i jeden dla zrzutów ekranu wysokiej jakości.

Następnie musiał wyszkolić swoją sztuczną inteligencję, aby przeprowadziła proces zwany przez sektor sztucznej inteligencji „odwrotnym obniżeniem wersji”. Najpierw pobiera obrazy o wysokiej rozdzielczości i obniża je do niższych rozdzielczości, śledząc utracone dane wizualne. Następnie musisz odwrócić proces i wyszkolić sztuczną inteligencję, aby uzupełniała brakujące dane z obrazów o niskiej rozdzielczości, tak aby odzwierciedlały one obrazy o wysokiej rozdzielczości.

Zespół Samsunga nazywa ten proces „formułą”. Jego renderery 8K zawierają bank formuł z bazą formuł dla różnych obiektów, takich jak jabłko czy litera „A”. Gdy mechanizm renderujący rozpozna rozmyte jabłko w dłoni aktora, przywraca krawędzie jabłka, naprawia artefakty kompresji i zapewnia, że białe piksele przybierają właściwy czerwony odcień w zależności od koloru. wygląd jabłek, a nie na niejasne algorytmy statystyczne. . Ponadto, wraz z przywracaniem określonych obiektów, sztuczna inteligencja dostosuje Twój strumień do tego, co widzisz.

Według Samsunga istnieją dziesiątki różnych „filtrów”, które zmieniają poziom tworzenia szczegółów, redukcji szumów i przywracania krawędzi dla danego strumienia, w zależności od tego, czy oglądasz sport, gatunek filmowy czy rodzaj filmu. kinematografia.

Obraz 1 z 5

(Źródło zdjęcia: Michael Hicks)

wspinaczka w akcji

Obraz 2 z 5

(Źródło zdjęcia: Michael Hicks)

Obraz 3 z 5

(Źródło zdjęcia: Michael Hicks)

Obraz 4 z 5

(Źródło zdjęcia: Michael Hicks)

Obraz 5 z 5

(Źródło zdjęcia: Michael Hicks)

Zdaniem inżynierów Samsunga przywrócenie konturów przedstawionych w poprzednim pokazie slajdów, niesamowitej ilości tekstu do przywrócenia w czasie rzeczywistym, nie jest nawet najtrudniejszym zadaniem dla sztucznej inteligencji. Zamiast tego replikacja odpowiednich tekstur obiektu w czasie rzeczywistym pozostaje trudnym wyzwaniem. Muszą się upewnić, że renderer poprawia wygląd obiektów, nie czyniąc ich nienaturalnymi.

To, czego procesor nie zrobi (według Samsunga), to błędna klasyfikacja obiektu. „To nie zmieni jabłka w pomidora” – zapewnił nas inżynier, ale bez rozwinięć. Najprawdopodobniej procesor jest przeszkolony w unikaniu radykalnych zmian, jeśli nie rozpoznaje, czym jest obiekt.

Nie zobaczysz, jak sztuczna inteligencja zmienia intencje filmowca, jak powiedział zespół Samsunga. Jeśli więc reżyser użyje efektu bokeh, rozmyte tło pozostanie rozmyte, a pierwszy plan zostanie złożony z ostrością do 8K.

Stwierdzili również, że nie patrzyli konkretnie na najpopularniejsze kanały w celu kategoryzacji obiektów, ale zamiast tego skupili się bardziej na ogólnej ilości i różnorodności treści. Nie wiadomo więc, czy mają formułę „smoka” czy „wilkołaka” dla swoich szalonych zegarów Game of Thrones.

Najnowsza seria telewizorów QLED

(Źródło zdjęcia: Michael Hicks)

Nowe telewizory Samsung 8K (i 4K) są dostarczane z zainstalowanym najnowszym bankiem formuł, a następnie dodawane są nowe dane obiektów za pośrednictwem aktualizacji oprogramowania układowego, które należy zatwierdzić. Samsung twierdzi, że będzie nadal testować nowe strumienie wizualne, aby rozszerzyć swoją bibliotekę obiektów, ale robi to lokalnie na serwerach Samsunga. nie analizuje danych z telewizorów osobistych.

Ile formuł produktów Samsung zgromadziłeś dzięki niekończącej się analizie strumienia? Jeden z ich inżynierów dał migawkę, która wydawała się niewiarygodna, sugerując, że procesor ogólnie rozpoznałby dużą liczbę obiektów na ekranie. Ale wkroczył urzędnik ds. Public relations i poprosił nas, abyśmy nie drukowali numeru, mówiąc, że wolą konsumenci skupić się na jakości działania Samsunga MLSR niż na arbitralnych liczbach.

Ulepszenia AI: nowa normalność?

Samsung nie jest jedynym producentem telewizorów, który obecnie wykorzystuje sztuczną inteligencję i przywracanie obrazu w swoich telewizorach.

Strona reklamowa Sony 4K zawiera niepokojące szczegóły dotyczące jej rozwiązań do przetwarzania obrazu AI. Nowe telewizory 4K zawierają procesory z „podwójną bazą danych” zawierającą „dziesiątki tysięcy” odniesień do obrazów, „które dynamicznie ulepszają piksele w czasie rzeczywistym”.

(Zdjęcie: Sony)

Przed targami CES 2019 firma LG ogłosiła również, że jej nowy układ telewizyjny a9 Gen 2 będzie obejmował przetwarzanie obrazu i uczenie maszynowe w celu poprawy redukcji szumów i jasności, w tym poprzez analizę źródła i typu nośnika oraz odpowiednie dostosowanie algorytmu.

Jednak poza elementami sztucznej inteligencji wydaje się, że te procesory telewizyjne nadal polegają w pewnym stopniu na zautomatyzowanych algorytmach. W naszym wcześniejszym wywiadzie z Gavinem McCarronem, szefem marketingu technicznego i planowania produktów w Sony Europe, na temat przetwarzania obrazu AI w telewizorach Sony, miał do powiedzenia:

„Kiedy przechodzisz z Full HD na 4K, musisz dużo zgadywać, a my staramy się jak najwięcej zgadywać. (Nasz procesor) nie patrzy tylko na izolację pikseli, patrzy na piksele wokół niego i na każdej przekątnej, a także wyszukuje piksele w wielu klatkach, aby zapewnić spójność jakości obrazu”.

Jest bardzo prawdopodobne, że Sony, podobnie jak LG i Samsung, używają algorytmu bilateralnego lub bicubic jako swojego systemu konwersji w górę. Następnie analizują zawartość o rozdzielczości bliskiej 4K i określają, które piksele powinny zostać wzmocnione podczas przetwarzania obrazu, a które należy usunąć jako szum.

W tym sensie większość producentów telewizorów jest stosunkowo blisko siebie w wyścigu o sztuczną inteligencję najwyższej klasy. Wyjątkiem jest Samsung, który stosuje te same techniki, ale uzupełnia cztery razy więcej brakujących pikseli, aby zmieścić się na wyświetlaczu 8K. Będziemy musieli poczekać i zobaczyć, czy wysiłki innych producentów AI pozwolą im również wejść na rynek 8K.